编者按:“中国AI到底发展得怎么样了?”在各种社交平台上,我们经常会看到这样的问题,也会看到各种各样的答案,但这些答案有着普遍的缺陷。它们往往只抽取一两个片段或案例,用非常取巧,甚至有点抖机灵的方式,极端唱好或者唱衰中国AI。

事实上,所谓的中国AI产业覆盖面非常广泛。每个领域有各自的发展特点,产业优势以及产业局限性,很难用过分简单的方式,来概括事实上非常复杂的AI产业。

或许,复杂的问题就应该有详细的答案。就像一幅小画,画不尽中国广袤的山水。

想要探寻中国AI的底色,需要梳理来龙去脉,需要回看一步一景,中国长卷(一):大国重算需要去画一幅长卷。

今天我们都知道,驱动AI算法工作的“燃油”是AI算力。尤其当深度学习算法发展到了预训练大模型阶段,AI算力已经成为整个AI领域的最大成本开销。根据相关数据,算力成本要占到大模型训练成本的70%左右,在大模型推理阶段则高达95%。

如果说,AI产业是一间工厂,那么AI算力就是工厂所需的煤和石油。更为致命的是,这些“煤和石油”的供应处在一种半垄断状态。在这次AI复兴当中,英伟达用GPU占据全球AI算力市场的主导地位。英伟达的高端AI算力不仅成本高昂,供不应求,但对于蓬勃发展的中国AI产业来说,能否确保其供应稳定都要打上大大的问号。

在算力贵且不稳的前提下,中国AI产业却涌现出了巨大的AI算力需求。根据相关数据预测,2030年全球AI算力的需求将达到2020年的500倍。其中,中国AI算力的增长是主要驱动力。目前阶段,中美之间的AI算力差不多是1比1.5。种种迹象显示,未来两国间的AI算力需求将拉平,甚至中国反超。

成本高昂、供应不稳,需求激增

,这三点勾勒出了中国AI算力的整体发展背景。

AI算力就是生产力。在种种令人不安的局面下,中国AI开始了聚沙成塔般的算力突围。

2017年,是人工智能第三次兴起的第一年。在这一年里,AlphaGO实现了对人类棋手的全面胜利,自动驾驶被广泛看好,深度学习算法四处开花。而这一切算法表现的背后,都离不开AI算力的支持。

这一年,英伟达拉开了股价飙升,AI算力产品频繁迭代的大幕。谷歌开始在云上布局TPU等自研算力。全球半导体产业开始看到AI算力这个极具想象力的新方向。

而与此前历次半导体风口不同的是,这次中国的从业者们没有后知后觉,待产业成熟后再加油追赶,他们选择了抢跑。

在2017年10月,海思打造了麒麟970,把端侧AI算力带到了华为手机。11月,中国科学院和寒武纪共同发布了新一代产品,其中包括面向手机与云端的AI处理器。这在当时被称为全球首个深度学习专用处理器芯片。

如果说,这些芯片还更多集中在端侧场景,不能直接对标英伟达提供的高端AI算力,尤其是AI训练算力,那么到了2018年,情况就正式发生了改变。

2018年10月,华为正式发布了全栈全场景AI解决方案。构成全站全场景AI主体的,是两款华为自研的AI芯片,也就是当年发布了用于推理的昇腾310,以及预告中的昇腾910,伴随着昇腾这个名字的出现,华为在AI基础设施领域的一系列布局开始浮现出来。

彼时,中美之间的贸易摩擦还没有开始。中国科技界不会料想到科技封锁的大棒即将迎面而来,更不会料想到AI算力这个还非常新颖、前沿的概念,居然会在几年后成为美国反复操纵,极力打击的中国科技“命门”所在。

如果没有华为对AI机遇的预判,昇腾在AI算力上的抢跑,或许后面的故事,就会是另一个走向。

2019年到2022年,中国AI算力发展进入第二阶段。简要概述这个阶段的发展目标,就是把AI芯片变成了AI算力。

提及AI计算,很多朋友会有种疑惑,一方面国产AI芯片似乎非常多,时不时就能看到相关报道,但另一方面却又都说AI算力卡脖子。其中的问题,就在于芯片和算力是有区别的。

芯片需要能够量产,能够变成板卡、服务器、小站等计算产品,还需要具备全套的软件生态来帮助用户进行调用、开发,需要与各个应用场景进行适配,证明可用性。

在这一系列问题都得到解决之后,还需要形成足够大的市场规模。

要顶着性能没有英伟达好,成本、生态、商业信任全都没有优势的逆境走向市场,国产AI算力这条路非常艰难。这也是为什么绝大多数国产AI芯片都只能停留在研制成功的新闻通稿里。

万幸的是,在中美贸易摩擦的背景下,这一阶段重要科技领域的自主可控成为各界共识,而AI算力在其中首当其冲。所以,国产AI算力没有像此前的算力国产化议题那样,反复被质疑是否有必要自研,全球化采购是否成本更优。因为理智的科技从业者都知道,AI算力被当作美国的棋子只不过是早晚的问题

。

在政策形势、市场需求,以及头部科技企业的带动下,国产AI芯片的算力转化虽然没有百花齐放,但也顺利完成了阶段性的目标升级。

2019年8月,可用于AI训练,能直接对标英伟达高端产品的昇腾910芯片正式发布。其整数精度(INT8)算力可以达到640TOPS,整体性能接近了英伟达的A100。这标志着,中国AI算力的“拳头产品”来到了全球一线水平。

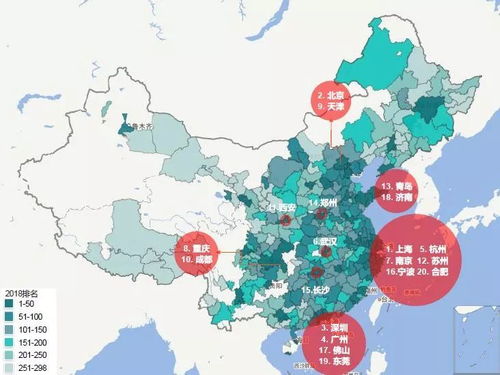

随后,昇腾生态的建设全面加速。深圳鹏城实验室基于昇腾910搭建了“鹏城云脑Ⅱ”,实现了中国首个自主可控的E级智能算力平台,可以提供不低于1000Pops的整机AI计算能力和64PB的高速并行可扩展存储。在武汉等25个城市,搭建了基于昇腾AI集群的人工智能计算中心,借助“东数西算”热潮,开启了云端AI算力这一新型基础设施的建设。

其他科技公司,同样也在这一阶段推动着AI芯片走向AI算力。百度在2020年量产了昆仑芯1代AI芯片,随后在百度搜索引擎、小度等业务中进行了部署。随后,基于百度自身业务与百度智能云庞大的AI算力需求,昆仑芯片达成了一定的量产规模。

先后布局AI芯片的,有华为这样的全产业链科技公司,也有阿里、百度等基于云计算业务拓展的AI芯片布局,同时还有寒武纪、海光信息、燧原科技、天数智芯、壁仞科技、摩尔线程、龙芯中科等半导体企业。中国AI算力的产业纵深,在一定程度上被拉开,IT市场的国产化AI算力选择也开始多样了起来。

时间来到2022年,一个关键性指标开始浮出。根据IDC发布数据,2022年中国AI加速卡出货量约为109万张,其中英伟达市场份额约为85%,昇腾市场占有率10%,百度昆仑为2%,寒武纪和燧原科技均为1%。

这意味着,中国AI计算市场上的国产化占比已经超过了10%。虽然这个规模看上去依旧不够大,但它意味着国产AI算力已经获得了稳定的市场基数,成为除了英伟达之外,中国AI计算具有可行性的第二选择。

这是用极限速度跑出来的10%,也成为中国AI产业的压舱石。

记得2018年,我与一些AI开发者、AI公司的创始人聊过GPU供应问题。在问到他们是否认为英伟达GPU会走向断供的问题时,大家普遍觉得不用担心,一方面是因为中国市场足够大,且增长足够快,英伟达不可能放弃,另一方面中美之间的AI技术差距还很明显,美国政府没有必要在这个领域出手干预。

然而事实证明,达摩克里斯之剑终会落下,我们永远不能乐观地认为科技铁幕上能打开一扇小窗。

2022年国产AI算力能够走向规模化商用的另一重推动力,是因为英伟达高端GPU的禁售风波

开始了。在此之前,英伟达雄踞了中国AI芯片市场超过90%的份额。但在2022年10月,美国商务部以担心军用转化为借口,对出口中国的AI芯片启动管制。其中,英伟达的H100和A100等高端GPU成为主要管制对象。

对于这个荒谬的新规,英伟达也并非没有寻找出路。作为禁令的对策,英伟达马上开发了两款专为中国市场设计的“平替”,也就是A800和H800。这两款GPU性能都低于美国制裁措施规定的阈值,但在性能降低的同时,价格却进行了上涨。

然而即使这样的替代方案,也在一年后被宣告“此路不通”。美国商务部在2023年10月宣布禁止英伟达向中国供应A800和H800,而且新的禁售令不仅影响英伟达,还将AMD和英特尔的芯片覆盖在内,并且影响了大量芯片设备厂商。这种做法,可谓是堵上了中国获取中高端AI算力供应的全部大门,甚至计划对使用亚马逊云、微软云等美国云计算平台来获取云端AI算力的中国企业进行限制。铁闸落下,空余无奈。

当然,英伟达也并没停下试试看的脚步。英伟达又一次设计了三款面向中国的“特供版”。其中,能够用于AI训练的H20在理论上只有H100的20%综合性能,缩水之严重令人惊叹。

至此我们或许可以说,依靠进口的中国AI算力之路已经被堵得水泄不通,接下来,只能路自己修,步自己走。

幸运的是,修出来的路还不止一条。在今天,国产AI算力已经可以通过多种方式供应市场。它们支撑着百模大战的繁荣,实现了英伟达禁令甚至没有激起太大的水花。当然,这些方式互有交叠,用户可以有多样化的搭配与选择。但整体而言,今天中国AI算力的来源有三条途径:

第一种,全国算力网络与云端AI算力。

在科技自立自强的大背景下,几年来中国极大程度上加强了AI算力设施的基础建设。作为“东数西算”的核心组成部分,中国兴建了大量智算中心,预计在2025年将提供超过105EFLOPS的AI算力,组成了一张庞大的AI算力网络。

而作为与国家AI算力基础设施结合相对紧密的运营商,也正在加紧提升对算力网络的利用与挖掘。在目前阶段,运营商纷纷加码云计算与AI大模型,逐渐形成了云端AI算力在技术上的成熟与长期成本上的优势。

与此同时,各大云计算厂商也加强了AI算力的投入。一方面赶在禁令之前,大量囤积英伟达高端显卡,另一方面也在探索自研AI芯片的使用,以及对其他国产AI算力的引入。

综合来看,全国一体化的AI算力网络,正在成为中国智能化的主要算力基石。

第二种,昇腾生态。

经过多年的发展,华为已经将昇腾建设为国内最为成熟,且完全没有英伟达GPU参与的AI计算生态。科大讯飞创始人刘庆峰曾经表示,华为的昇腾AI芯片可以达到与英伟达A100相当的性能。

相对来说,昇腾的优势在于软硬件体系较为齐备,可以广泛使用华为自研的技术进行支持;可以和同样由华为打造的鲲鹏生态结合,实现多元计算;整体产业生态较为繁荣,硬件、软件合作商丰富。弱势之处则在于,外界对昇腾芯片还是有性能不足与价格过高的质疑,并且昇腾生态相对封闭,与其他厂商的AI算力生态基本不打通。

今天,中国已经有一半的大模型由昇腾来支撑,并且华为云已经将昇腾算力带到了云端,推出了昇腾AI云服务。可以说,昇腾的出现和成长,让中国有了可以对标英伟达生态的AI算力选择。

第三种,异构智算。

昇腾之外,大多数AI芯片厂商还无法实现规模化出货,更多是以参与混合型算力的方式,加入数据中心、企业AI集群的建设当中。目前情况下,大多数企业与数据中心还是会选择英伟达来构建AI算力的主体,同时通过加入海光、寒武纪等国产芯片以及加速卡来构建AI算力,或者采取使用英伟达GPU进行训练,使用国产AI算力进行推理的模式。比如说,百度在文心一言训练中使用的是英伟达GPU,推理侧则使用自主研发的昆仑芯2代。

类似策略,可以逐渐降低对英伟达的依赖度,并且发挥出多元化的AI芯片优势。由此,异构智算开始成为企业和数据中心新的需求。

面向这种需求,IT厂商也正在捕捉机会。比如联想推出了完全异构智算平台,来帮助实现异构化AI算力的管理与调配;新华三推出了面向异构智算的网络解决方案,解决异构智算带来的丢包与负载等问题。

这三根“足”,给中国AI算力带来了某种稳定性。经过极限情况下的多年经营与发展,今天中国AI算力谈不上充沛与廉价,至少有了可以遮风挡雨的稳固。

至少我们可以看到,中小企业应用AI算力的综合门槛正在降低,AI算力的选择在增多,异构协同能力在加强,并且熟悉了昇腾与海光DCU这样能够直接替代英伟达GPU的存在。中国AI是否会因为算力而陷入生存僵局,已经不再是个问题。

总结一下,在AI算力层面,我们有办法,但办法不够好,其实也不够多。

然而换个角度想想,幸好我们有方法,否则麻烦就大了。

依靠精准的预判抢跑,在多重助力下超高速发展,在外部压力下极限成型。

智算,终成国之重器。